הקישור האחרון שהופיע במהדורה הקודמת של ״פרימיום קליקבייט״ היה לכתבה של עידו דוד כהן ב״הארץ״ (קישור מתנה, פתוח גם למי שאינו מנוי), שעסקה בשימוש של עיתונאים ישראלים בכלי בינה מלאכותית. לא התעכבתי אז יותר מדי על הנושא – רק ציינתי אותה בהקשר של כתבה דומה ב״ניו יורק טיימס״, שהתפרסמה כמה ימים קודם לכן. הפעם, נצלול קצת יותר לעומק של הזירה המקומית, ולדוגמאות ולטענות שעלו בכתבה. כי למרות שהיא הייתה מעמיקה למדי ומעניינת, אני חושב שהתפספסה שם נקודה חשובה.

אעמיד פנים שאני צ׳אט ג׳יפיטי ואסכם לכם את הנקודות המרכזיות: עיתונאים עושים שימוש בכלי בינה מלאכותית, הם לא תמיד מיידעים את הקהל שלהם על השימוש הזה, הם לא תמיד בודקים את התוצרים, והדבר מייצר לא מעט תקלות ומבוכות – ממשפטים מצחיקים שחומקים מתחת לרדאר (״רוצה שאעצב את זה גם כידיעה עיתונאית מלאה?״ או ״אכין כתבה חדשה המתמקדת במה שביקשת״) ועד הזיות והמצאות של ממש. כותרת הכתבה המחישה את הנקודה היטב – ״כתבה זו נכתבה ללא שימוש בבינה מלאכותית״ – וכותרת המשנה ציינה אמנם ש״AI יכול לייעל תהליכי עבודה עיתונאיים״, אבל ש״הסתמכות יתר עליו עלולה לגרום לפדיחות״. וכאן לדעתי הנקודה שהתפספסה בסיפור: זו לא הסתמכות יתר שגורמת לפדיחות. הסיבה הסבירה יותר לכך שגופי תקשורת בישראל מפשלים בשימוש שלהם בבינה מלאכותית, היא שהם לא משתמשים בה מספיק.

זו נקודה ששווה להתעכב עליה. עיתונות באופן כללי, למרות העובדה שהיא חשופה ל-disruptions מכל עבר, היא תעשייה די שמרנית. בטח בגופי תקשורת ששורשיהם בעיתונות המודפסת. ולכן, זה לא מפתיע שבגופים עיתונאיים רבים – בעיקר בעולם המערבי – ניתן לזהות הססנות גלויה באימוץ של טכנולוגיות חדשות.

אבל זה לא בהכרח היה המצב בישראל: אם תסתכלו על התקשורת המקומית מזווית טכנולוגית/דיגיטלית, תגלו שוק תוסס והרפתקני. אתרי חדשות ישראליים היו לא פעם בין הראשונים לאמץ טכנולוגיות חדשות. זה כנראה נבע משילוב של זירה תחרותית מאוד, מציאות חדשותית אינטנסיבית, האופי והתרבות הישראליים, וקרבה פיזית לתעשיית ההייטק המקומית – במהלך השנים שלי ב-ynet, יצא לי להיות beta tester או design partner של לא מעט מוצרים חדשניים: פשוט היינו בסביבה. בפורומים בינלאומיים שונים שבהם יצא לי לקחת חלק, עיתונאים ממדינות אחרות לא פעם נדהמו מקצב החדשנות וההתנסות שלנו.

זה ממש לא המצב כשאנחנו מסתכלים על השימוש בכלי בינה מלאכותית. יוצא לי להיחשף היום לא מעט באופן ישיר לגופי תקשורת ממדינות שונות, לצד האובססיה הרגילה שלי לצריך כל ריאיון, דו״ח או פודקאסט שעוסק בנושא. הכתבה של ״הארץ״ והדוגמאות שבה מאששות את החשד שלי: אנחנו משתרכים מאחור.

למה זה קורה? התירוץ הקל ביותר הוא מכשול השפה. מודלי שפה גדולים מצטיינים, ובכן, בשפות ״גדולות״. גם היום, שלוש שנים לתוך המהפכה, היכולות של ChatGPT, ג׳מיני או קלוד בעברית חלשות בהשוואה ליכולות שלהם באנגלית. זה בא לידי ביטוי גם ביכולת הניסוח – מידת העלגות או ה״טכניות״ של הטקסט – אבל גם, ובעיקר, ביכולת שלהם לשלוף מידע ספציפי באופן אמין ומדויק. ואם זה לא מספיק, יש פה גם עניין של עלויות: שימוש ב-LLMs בקנה מידה רחב, דרך API, מתומחר לפי Tokens – ובמובן זה עברית היא שפה ״יקרה״ יותר (צורכת יותר Tokens למשפט – בהכללה גסה, בערך פי שניים).

אבל כאמור, זה בעיקר תירוץ. גם אם יש פער בין עברית לאנגלית ברמת הניסוח, במידת הדיוק ובמחיר – זה לא אמור למנוע שימוש רחב היקף באופן כללי: אפילו בהינתן המגבלות האלה, אפשר להשיג המון. ועובדה, כפי שעולה מהכתבה, שישנם עורכים שמשתמשים בזה. החשד שלי הוא שדווקא אותן תכונות שגרמו לגופי תקשורת ישראלים לצעוד בחזית הקדמה, הן אלה שמקשות עליהם באימוץ יעיל של כלי בינה מלאכותית.

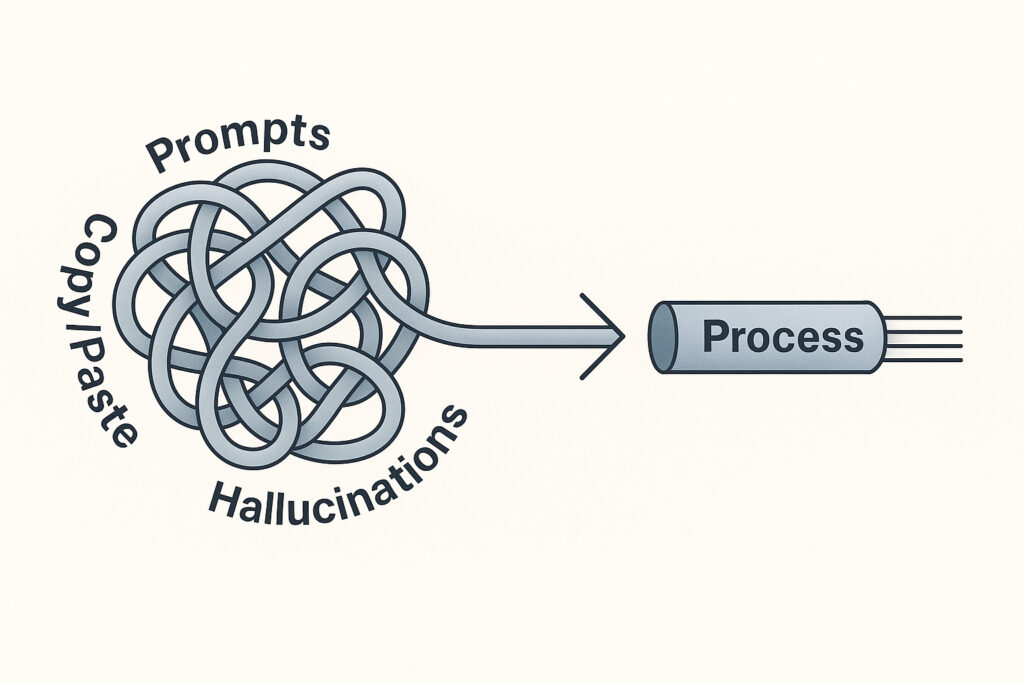

בניגוד לטכנולוגיות קודמות שנכנסו למערכות עיתונאיות, בינה מלאכותית מציבה כמה אתגרים ייחודיים. הלוסינציות הן רק חלק קטן מהאתגרים האלה: כל מי שניסה להשתמש בכלי AI באופן שיטתי בתהליכי העבודה שלו, ודאי שם לב שהן לא בהכרח הבעיה העיקרית. יש לכלים האלה יכולות מאוד מגוונות ורחבות – וזה מחייב מערכות וארגונים לדייק את השימוש בהן: באיזה כלי משתמשים ומתי, אילו משימות מתאימות להטמעה כזו ואילו לא, בחינה של יחסי עלות-תועלת לאורך זמן, הגדרת גבולות ברורים, בניית סטנדרטיזציה של כלים ושימוש באופן רוחבי, צמצום פערים בין מי שעטים על הטכנולוגיה לבין אלה שמהססים. בקיצור – זה לא סתם להכניס כלי חדש ולשחק איתו: זה תהליך של ממש. והתקשורת הישראלית, איך לומר, לא תמיד מצטיינת בצד ה״תהליכי״.

למעשה, אחד הדברים החשובים ביותר לארגון שמנסה להכניס כלי בינה מלאכותית הוא פשוט סדר. ארכיון מסודר, דאטה מסודר, תהליכים מסודרים, ניהול ידע מסודר – כל הדברים האלה מאוד עוזרים כשאנחנו רוצים להתאים כלי בינה מלאכותית למשימות פנימיות. גם לאופן שבו הארגון מתנהל – היררכיה ברורה, תחומי אחריות, תקשורת פנימית – יש השפעה מכרעת. וגם כאן, גופי תקשורת ישראליים לא תמיד מצטיינים (וסליחה על ההכללה הגסה – אבל זה מה שעולה ממה שראיתי וממה ששמעתי מקולגות).

הדוגמאות המובאות בכתבה ממחישות זאת היטב. כשאני נתקל במשפט כמו "תכין כותרת ראשית וכותרת משנה ופסקה שמתמצתת הכול ב–5 שורות", אני מבין שהבעיה פה היא לא שהעורך השתמש בצ׳אט כלשהו – אלא שהוא השתמש בצ׳אט כלשהו, במקום בכלי מוסדר שמוטמע בתוך תהליכי העבודה הקיימים. כנ״ל עם משפט כמו "תודה על המשוב והכוונה. אתה צודק לגמרי — הדגש צריך להיות על המקרה הספציפי של טיסת אייר אינדיה והשלכותיו. אכין כתבה חדשה המתמקדת במה שביקשת": הבעיה אינה (רק) העורך ששכח למחוק את המשפט – הבעיה היא גם הארגון, שלא דאג להטמיע מערכות פנימיות מותאמות, כאלה שבהן השיח הזה כלל לא היה צריך להתנהל.

וכאן אנחנו מגיעים לבעיה הכי גדולה עם כלי בינה מלאכותית: הזמינות שלהם. כל אחד יכול להשתמש בצ׳אט. אפילו לא צריך מינוי, ברוב המקרים. אנשים ישתמשו בהם, בין אם תתנו להם ובין אם לא. אפשר גם להשתמש בהם בלי שום תהליך של אימון ספציפי, דיוק או ״הנדסת פרומפטים״ (מישהו עדיין משתמש במונח הזה?).

הפתרון הקל הוא פשוט לתת לאנשים לעבוד עם זה, ולהגיד – כמו אורי דגון, סגן עורך ״ישראל היום״ המצוטט בכתבה – ש״בהגדרה, אין אצלנו דבר כזה להעלות 'העתק הדבק' לידיעה חדשותית בלי בדיקה של עורך״. איך אומרים? Rules were meant to be broken. אם אתה רוצה למנוע טעויות (ושום דבר לא ימנע אותן ב-100%, אבל אפשר לשאוף לכך), עדיף למסד תהליכים שיחסכו את הפדיחה הפוטנציאלית במקור. כשאתה אומר משהו כמו ״אם יש כתבה על החזרת חלל חטוף, למשל, אתה פונה ל־AI שייתן שלוש פסקאות — 'שחזר לי בקצרה את כל החללים החטופים שהוחזרו עד כה'״ – אתה מרים להנחתה. מישהו, בסוף, יעתיק את התשובה המלאה של הצ׳אט פנימה, לא משנה כמה פעמים תגיד להם שאסור.

כמובן, פתרון אלטרנטיבי הוא פשוט לאסור על השימוש. אבל גם זה פספוס: אף אחד לא רוצה להיות הארגון הכי פחות יעיל בזירה שבה הוא פועל. זה גם לא פרקטי: זה כמו להגיד לסטודנטים לא להשתמש בצ׳אט ג׳יפיטי בעבודות שהם מגישים. בעיניי, הדבר הנכון הוא לא לאסור, אלא לדאוג שלעיתונאים יהיו כלים עם הגדרות שימוש ברורות, שמירה על פרטיות החומרים והתאמה לסטנדרטים המקצועיים של הארגון. ולא, לרכוש מינוי ארגוני ל-ChatGPT כמו שמצוין בכתבה, זה לא ממש בכיוון.

אז איך עושים את זה? הנה כמה טיפים שיכולים לעזור למי שמתמודד היום עם אתגרים דומים. מה שנקרא, טיפים שנכתבו בדם מלאכותי.

ידע >> תהליכים >> ניתוח >> הטמעה. התהליך הזה די פשוט בסופו של דבר: אנחנו רוצים לסדר את הידע שלנו (דאטה, ארכיון, תבניות כתבה, סגנון וכו׳), לתעד את תהליכי העבודה הקיימים (ועל הדרך, רצוי לוודא שהם אכן אחידים ככל שניתן), לנתח אילו משימות אפשר יהיה לבצע באמצעות AI, מה תהיה העלות וכמה זה ייעל את העבודה, להבין איזו מעורבות אנושית נדרשת, ובסופו של דבר להטמיע את הכלים המתאימים.

עבודה ב-Top >> Down. עיתונאים צריכים לדעת שזה חשוב לארגון. הם צריכים להבין מה המטרה (לאפשר להם לפרסם כתבות מהר יותר? לשחרר אותם למשימות איכותיות יותר? לשפר את המוצר העיתונאי? לחסוך כוח אדם?), ומה הציפיה מהם. כשאין הירתמות ארגונית שמגיעה מלמעלה, Early adopters פשוט יתחילו להתנסות באופן לא מוסדר – ואחרים יגררו רגליים.

עבודה ב-Bottom >> Up. תמיד יהיו עובדים יצירתיים, עם קליטה טכנולוגית מהירה, שימצאו שימושים שלא חשבתם עליהם קודם. תנצלו אותם: ב-ynet ניהלנו פורום קטן של ״שגרירי AI״ – עובדים משלל מחלקות שסיפרו זה לזה על הכלים שהם משתמשים בהם, ונעזרנו בהם לבחון כלים חדשים ולהפיץ אותם בקרב קולגות.

הגדרת עקרונות עבודה. כיוון שתמיד יישארו אזורים פחות מנוטרים, ושימוש פרטני של עובדים (ממש כמו שהם משתמשים בגוגל או בוויקיפדיה), חשוב להסדיר את עקרונות השימוש הפנימיים. מתי נדרש גילוי נאות בכתבה? באילו שימושים צריך לעדכן מנהל ישיר? באילו מקרים אסור להשתמש במערכות פתוחות בגלל דאטה רגיש? זה נכון שהכלים משתנים כל הזמן, אבל עקרונות עבודה טובים לא באמת מחייבים שינויים כל כך תדירים.

תקשורת פנימית. חשוב מאוד, בכל הכיוונים. בין הארגון לעובדים, בין עובדים לקולגות. צריך לעודד שיתוף, לעדכן באופן שוטף על כלים חדשים, תכנון קדימה, תקלות ואתגרים. רצוי שיהיה ברור מאוד גם לאן פונים עם שאלות, הצעות ובעיות טכניות.

נצחונות קטנים. זה תמיד נכון: גם אנשים שחוששים להשתמש ב-AI עשויים לשנות את דעתם כשהם יתקלו בשימוש שפשוט עושה להם את החיים קלים. ב-ynet זו הייתה מערכת התמלול האוטומטית, שהוטמעה ב-CMS הפנימי. כשנחסכות ממך שעתיים של תמלול ריאיון, אתה תחבק את הבינה המלאכותית לא משנה כמה אתה לודיט.

כלים פנימיים ומותאמים. זה אולי הכי חשוב, דווקא בגלל שהעבודה העיתונאית חשופה כל כך וכל טעות זוכה לצילומסך תוך שנייה. אל תתנו לעורכים לעבוד בפרומפטים חופשיים עם הצ׳אט המועדף עליהם – לא מאוד מסובך להקים מערכות פנימיות שמחוברות למודלים השונים באמצעות API, ושכוללות אימון ודיוק מאחורי הקלעים, עוד לפני הפרומפט. אפשר להגביל את הגישה למאגרי ידע חיצוניים, להציע תבניות מוגדרות מראש (פסקאות רקע, מבזק וכו׳) ואפילו להכניס ״סוכני QA״ שיבדקו את התוצרים. זה אולי לא יחסוך את כל הטעויות, אבל זה כנראה יחסוך את רובן. ואפילו אם אין לכם יכולת או משאבים לעבוד בסביבה פנימית – הקמה של כמה Custom GPTs למשימות שונות, עם קונטקסט ברור והנחיות קבועות, זה צעד לא רע בכיוון הנכון. כנ״ל לגבי פרויקטים משותפים ב-NotebookLM של גוגל, כלי שכנראה יחרטט אתכם קצת פחות.

שיטתיות ועקביות. זו לא הטמעה חד פעמית. צריך להחזיק את התהליך הזה – לנהל פגישות קבועות, לאסוף פידבקים, למדוד הצלחה, לעדכן יעדים ועקרונות עבודה.

אם זה נשמע לכם כמו תהליך מייגע, יכול להיות שאתם צודקים. זה מורכב, וזה לוקח זמן. יותר קל פשוט לבקש עזרה מהצ׳אט ולהעמיד פנים שכלום לא קרה. עד הפדיחה הבאה.

עכשיו תן לי פידבק על המהדורה ותנסח לי פרומפטים לתמונות אילוסטרציה ופוסט ללינקדאין.

נמשיך בקו הזה עם המלצות שיעזרו לכם להבין איך אפשר להשתמש בכלי בינה מלאכותית בצורה חכמה ואחראית. יש שני פודקאסטים שעוסקים ספציפית בנושאים האלה, כמעט בכל פרק – The Media Copilot ו-Newsroom Robots. בשניהם יצאו ממש בשבועות האחרונים פרקים מאוד רלוונטיים: ריאיון עם ראש תחום ה-AI בחדשות ה-BBC (ספוטיפיי, אפל), ועם ה-COO של טיים (ספוטיפיי, אפל).

עכשיו אתם תגידו – בצדק כנראה – שאלה גופי ענק, ויש להם משאבים כמעט אינסופיים להתמודד עם אתגרי השעה. אבל זה ממש לא המצב עם הדו״ח המעולה הזה, שמרכז עשרות יוזמות AI שהוקמו על ידי גופי חדשות קטנים יחסית בעזרת תמיכה של Google News Initiative (כולל הופעת אורח מקומית).